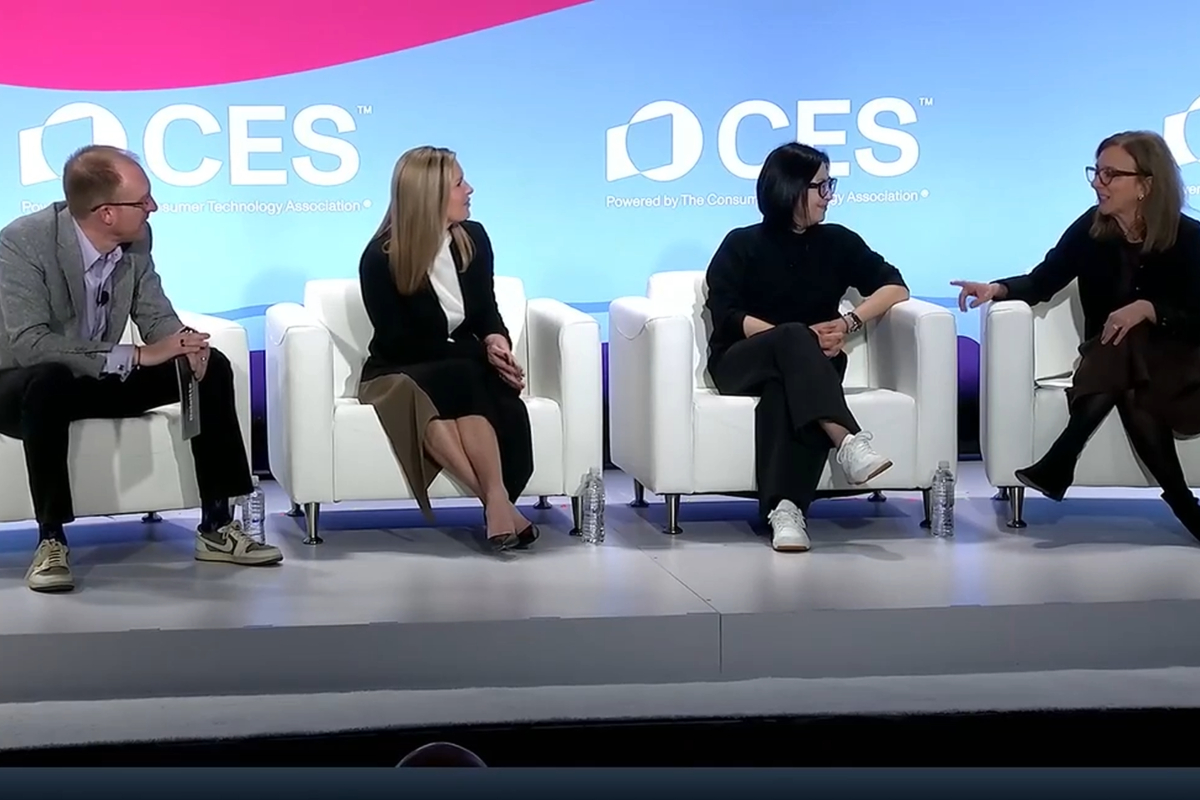

Foto: Axel Olivares (Composición/NotiPress)

El 6 de enero de 2026, durante el Consumer Electronics Show (CES) de Las Vegas, Deloitte presentó su conferencia Tendencias tecnológicas 2026: El futuro nos llama. En la presentación, líderes de la industria debatieron sobre el impacto ético de la inteligencia artificial y la necesidad urgente de construir confianza estructural en estas tecnologías emergentes.

Durante el evento, Bill Briggs, director técnico de Deloitte, remarcó que la mayoría de las inversiones en IA continúan centradas en lo técnico y no en lo humano. "En parte del estudio, vimos que 93% de las inversiones en IA están en tecnología, 7% en cultura, capacitación y desarrollo", afirmó, subrayando la brecha la cual impide alcanzar el potencial tecnológico.

Así, desde una perspectiva ética, Paula Goldman, directora de ética y uso humanitario de Salesforce, subrayó que la confianza no puede verse como una política aislada, sino como una parte integral del diseño tecnológico. "Tenemos que lograr que la confianza sea parte de la arquitectura y no solo un proceso que se superpone", declaró. Añadió que esto implica construir ciclos de confianza desde el inicio del desarrollo de productos, con pruebas rigurosas y mecanismos de observación permanente para clientes empresariales.

Bill Briggs, Paula Goldman, Ming Mau, Courtney Naudo en la conferencia Tendencias tecnológicas 2026: El futuro nos llama en CES 2026. Fuente: CES

En este sentido, la visión presentada por Walmart destacó la integración de agentes IA en sus operaciones cotidianas. Courtney Naudo, vicepresidenta senior de planificación e integración de la empresa, enfatizó cómo estas herramientas no pueden desarrollarse por separado, sino como parte del núcleo de su infraestructura. "Pensamos en la IA como infraestructura central, no como algo aparte", explicó, haciendo referencia a la implementación de Sparky, su asistente virtual de compras, y el uso de agentes internos para mejorar la eficiencia del personal en tiendas físicas.

La conversación seguida por NotiPress también abordó el vínculo entre humanos y sistemas autónomos en entornos laborales. Según Goldman, las empresas deben redefinir la relación con los agentes IA, estableciendo mecanismos de control claro. "Usamos la frase ‘humano al mando’. Sí, la IA será más autónoma, pero las personas siempre deben tener el control", sostuvo. En Salesforce, esto se traduce en flujos donde los agentes atienden tareas repetitivas, pero las decisiones complejas se escalan a personal humano, como sucede con clientes como Pandora o firmas contables en temporada fiscal.

De acuerdo con los expertos, rediseñar con una colaboración entre humanos y agentes implica desarrollar nuevos procesos que difieren de los recursos humanos tradicionales. Las empresas deberán definir responsabilidades, establecer protocolos de supervisión y crear esquemas de prueba que aseguren resultados fiables sin necesidad de revisión individual.

El encuentro concluyó con una advertencia: en un entorno saturado de avances y expectativas, postergar la acción puede marginar a organizaciones enteras. Briggs insistió en que no es momento para esperar la próxima versión tecnológica, sino de actuar con criterio, evaluando riesgos éticos y consecuencias sociales.

DESCARGA LA NOTA SÍGUENOS EN GOOGLE NEWS