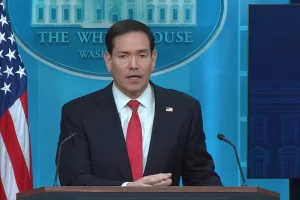

Foto: Gustavo Torres (NotiPress)

Rumbo a las elecciones presidenciales de 2024, ChatGPT y DALL·E 3 se perfilan para combatir la desinformación que pueda ser utilizada con fines electorales. De acuerdo con OpenAI, compañía responsable de esta inteligencia artificial (IA), el equipo de desarrollo trabaja para mitigar la creación de deepfakes y contenido engañoso, especialmente relacionado con los candidatos.

Desinformación en tiempo de elecciones

El 2024 será un año electoral de relevancia global, con 76 países en elecciones y al menos 51% de la población involucrada en el ejercicio electoral. Bajo esta línea, existen dos frentes de cuidado para la ciberseguridad, según expertos, los sistemas críticos son: el voto electrónico y las medidas para prevenir la desinformación dirigida al sector votante.

Así, la secretaria electoral del Instituto Nacional Electoral (INE), Carla Humphrey, considera que los sistemas democráticos se pueden ver afectados por el flujo de la información, así como su veracidad. En un artículo del 17 de marzo de 2023, compartido por el Instituto Nacional Electoral (INE), Humphrey informó que las noticias falsas tienen un impacto negativo sobre la sociedad; y en el contexto electoral, la desinformación es capaz de modificar las preferencias de los votantes.

El papel de OpenAI para combatir la desinformación electoral

Para OpenAI, las herramientas tecnológicas novedosas deben pasar por una serie de retos antes de alcanzar su mejor potencial. En el caso de sus implementaciones de IA, la fidelidad y transparencia de la información son dos aspectos que estarán al frente durante las campañas electorales del 2024.

Al tratarse de herramientas que aprenden de los hábitos de sus usuarios, ChatGPT y DALL·E son observadas en tiempo real para medir el impacto del texto e imágenes producidas con inteligencia artificial. Según métricas de Exploding Topics, la herramienta conversacional GPT cuenta con más de 180 millones de usuarios, y 70% del contenido de redes sociales proviene de la plataforma Youtube.

Por su parte, las políticas de uso de cualquier contenido creado con la inteligencia artificial de OpenAI se encuentran en constante evolución. Con motivo de las exigencias de información en el año de elecciones, la compañía aseguró, cualquier usuario que use las herramientas para hacerse pasar por un candidato político será vetado de la plataforma.

Asimismo, OpenAI anunció una alianza con la National Association of Secretaries of State para supervisar el proceso de creación de texto a imágenes. Mediante preguntas de logísticas en materia electoral, las autoridades podrán dar seguimiento a la fuente de la desinformación que afecten la percepción sobre las votaciones, agregó.

Cabe señalar que, además de crear noticias falsas, ChatGPT puede ser hacerse pasar por uno de los candidatos a la presidencia y aumentar las probabilidades de engañar a los usuarios. De igual manera, DALL·E es capaz de generar imágenes complementarias al contenido creado en GPT, por lo cual se trata de una amenaza doble.

DESCARGA LA NOTA SÍGUENOS EN GOOGLE NEWS